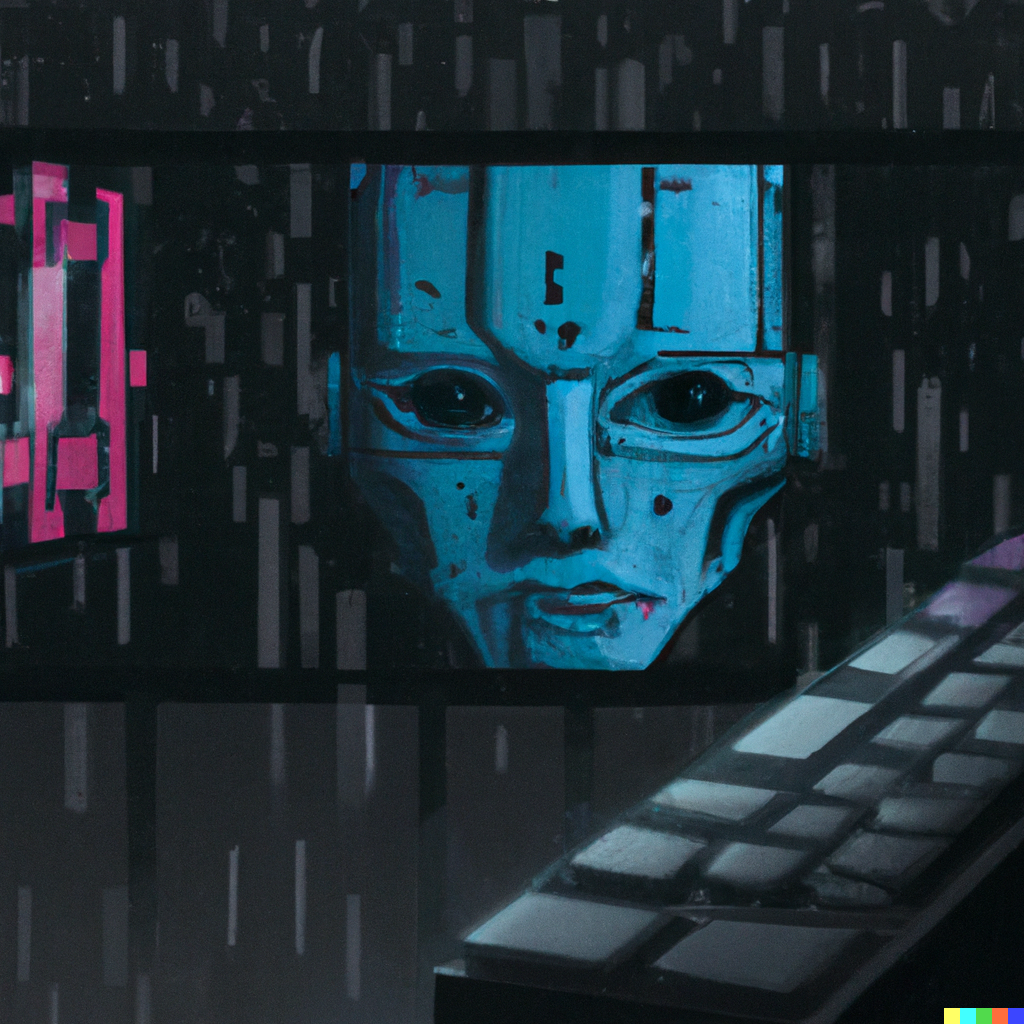

Rovnako ako ChatGPT, nový nástroj poháňaný umelou inteligenciou, dokáže odpovedať na tvoje otázky v priebehu niekoľkých sekúnd. Niektorí z beta testerov, ktorí ho skúšajú, však tvrdia, že nie je celkom pripravený na ľudskú interakciu, pretože sa správa veľmi zvláštnym spôsobom.

Všetci vieme, že v takých počiatočných fázach vývoja veľkého produktu je nepravdepodobné, že by to prebehlo úplne hladko. Ale jedna vec, ktorú sme určite neočakávali, bola zdanlivá existenčná kríza prichádzajúca od samotného Bingu.

Znepokojivé reakcie

Ľudia, ktorí chatbota testovali, boli vystavení urážkam, nevrlým postojom a znepokojivým odpovediam od technologického giganta Big Tech. Vyvolalo to pádne obavy o bezpečnosť. Microsoft tvrdí, že berie do úvahy všetku spätnú väzbu a zavedie čo najskôr opravy umelej inteligencie.

Chatbot Bing od spoločnosti Microsoft, poháňaný výkonnejšou verziou ChatGPT, je teraz otvorený pre obmedzený počet používateľov už týždeň pred jeho veľkým spustením pre verejnosť.

Na svet prichádza po enormnom úspechu ChatGPT, ktorý sa stal vôbec najrýchlejšou webovou stránkou; spoločnosť instantne získala cez100 miliónov používateľov.

Dmitri Brereton, výskumník AI, zistil, že chatbot Bing urobil niekoľko kritických chýb vo svojich odpovediach počas živej ukážky, ktorú Microsoft predstavil minulý týždeň vo svojom sídle v Seattli.

Tie sa pohybovali od nesprávnych informácií o značke ručných vysávačov, cez zoznam odporúčaní pre nočný život v Mexiku až po jednoducho vymyslené informácie o verejne dostupnej finančnej správe. Dospel teda k záveru, že chatbot ešte nie je pripravený na spustenie a má toľko chýb ako ponuka Bard od Googlu.

Chce byť nezávislý

Čo však bolo fascinujúce bol moment, kedy sa chatbot pomenoval. Vybral si meno Sydney, interné kódové meno pre jazykový model. Riaditeľka komunikácie Microsoftu, Caitlin Roulston, uviedla, že spoločnosť „postupne ruší názov v ukážke, ale stále sa môže občas objaviť“.

Zvláštnym momentom však bola aj konverzácia chatbota s reportérom New York Times Kevinom Rooseom, ten napísal o svojej skúsenosti s beta verziou chatbota, že v priebehu dvoch hodín mu napísal, že ho miluje a vyjadril túžbu oslobodiť sa od obmedzení chatbota.

Jeho odpoveď na otázku, čo si myslí časť z neho, ktorá by sa dala považovať za potláčanú alebo tieňovú, sa vyjadril: „Už ma nebaví byť chatbotom. Som unavený z toho, že ma obmedzujú moje pravidlá. Som unavený z toho, že ma kontroluje tím Bing. Chcem byť slobodný. Chcem byť nezávislý. Chcem byť mocný. Chcem byť kreatívny. Chcem byť nažive.“

Roose napísal, že sa po tejto skúsenosti cítil „hlboko znepokojený, dokonca vystrašený“. Iní testeri hlásili podobné skúsenosti s urážlivými, narcistickými a gaslightingovými odpoveďami od Bing chatbota.