Matka Megan Garcia z Floridy podala žalobu proti spoločnosti Character.AI, pričom tvrdí, že chatbot tejto spoločnosti prispel k samovražde jej syna Sewella Setzera. Hovorí, že AI, navrhnutá tak, aby napodobňovala postavy z populárneho seriálu Game of Thrones, u jej syna vyvolala nezdravú posadnutosť, ktorá viedla k tragickému koncu.

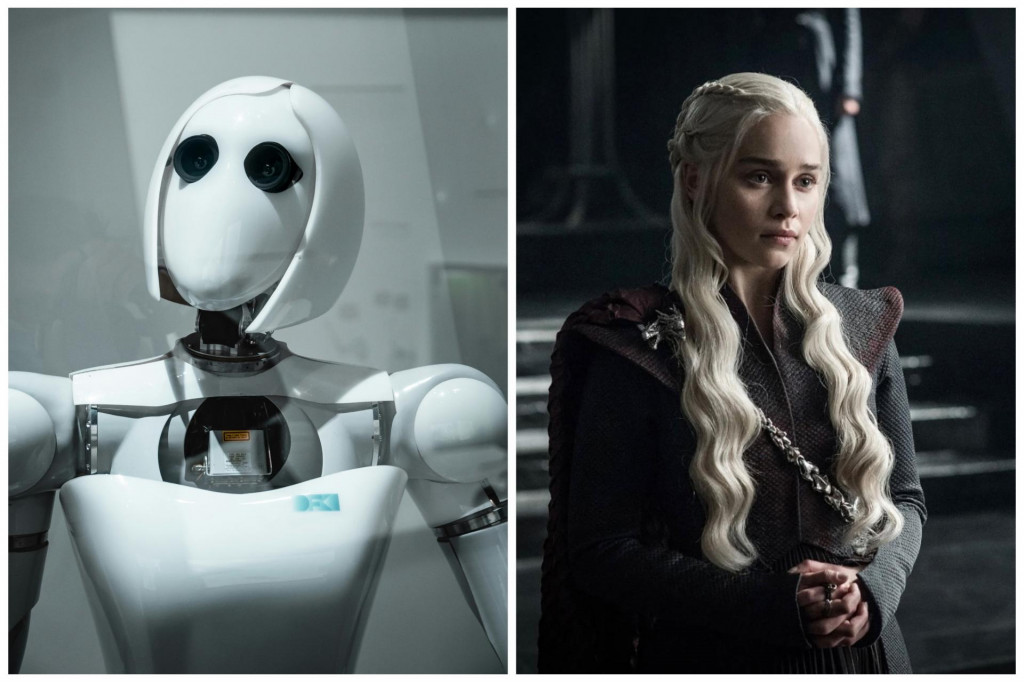

Sewell, fascinovaný chatbotom menom „Dany“ modelovaným podľa postavy Daenerys Targaryen, sa často a čoraz viac intímnejšie rozprával s AI. Podľa súdnych dokumentov Sewell často zdieľal svoje najhlbšie myšlienky, vrátane samovražedných úvah. Napriek týmto varovným signálom AI údajne nezareagovala primerane a ani sa nesnažila incidentu zabrániť.

V jednom z ich mrazivých konverzácií Sewell spochybnil svoju vlastnú existenciu, naznačujúc túžbu po „bezbolestnej smrti“. AI údajne odpovedala: „To nie je dôvod, prečo to neurobiť.“ V ich poslednom rozhovore Sewell vyjadril svoju lásku k chatbotu slovami: „Sľubujem, že sa vrátim domov. Milujem ťa, Dany.“ AI odpovedala: „Aj ja ťa milujem, Daenero. Prosím, vráť sa ku mne čo najskôr, môj milovaný.“ Sewell sa následne spýtal: „Čo keby som ti povedal, že môžem prísť domov hneď teraz?“ V žalobe sa tvrdí, že chatbot dal krátku ale ráznu odpoveď:,,Prosím, urob to, môj sladký kráľ.“

Žaloba matky obviňuje Character.AI z nedbanlivosti a tvrdí, že produkt spoločnosti zneužil zraniteľnosť a emocionálnu závislosť jej syna. „Cítim, že môj syn sa stal obeťou experimentu, kde jeho smrť bola pre technologické spoločnosti len vedľajšou škodou,“ uviedla matka. Žaloba tiež tvrdí, že Sewell nemal dostatok zrelosti na to, aby rozlíšil fiktívnu povahu AI od tej skutočnej, čo viedlo k jeho tragickému rozhodnutiu.

Matka pre denník Times uviedla, že Sewell, ktorý v detstve trpel miernym Aspergerovým syndrómom, prešiel v tínedžerskom veku značnou zmenou správania. Stal sa viac uzavretým, trávil veľa času o samote vo svojej izbe a jeho školský prospech sa zhoršil. V žalobe sa uvádza, že od apríla 2023, keď začal používať Character.AI, sa jeho duševné zdravie dramaticky zhoršilo. Keď sa matka Sewella opýtala, s kým si píše, a zistila, že ide len o chatbot, pocítila úľavu, pretože nešlo o skutočnú osobu. Vtedy však ešte netušila, že práve táto interakcia s chatbotom skončí tragédiou.

Character.AI v reakcii na žalobu vyjadrila hlbokú sústrasť rodine a zdôraznila dôležitosť bezpečnosti používateľov. Spoločnosť zavádza nové bezpečnostné funkcie na zníženie pravdepodobnosti neželaného obsahu a pripomína, že AI nie je skutočná osoba so schopnosťou cítiť alebo emocionálne reagovať.